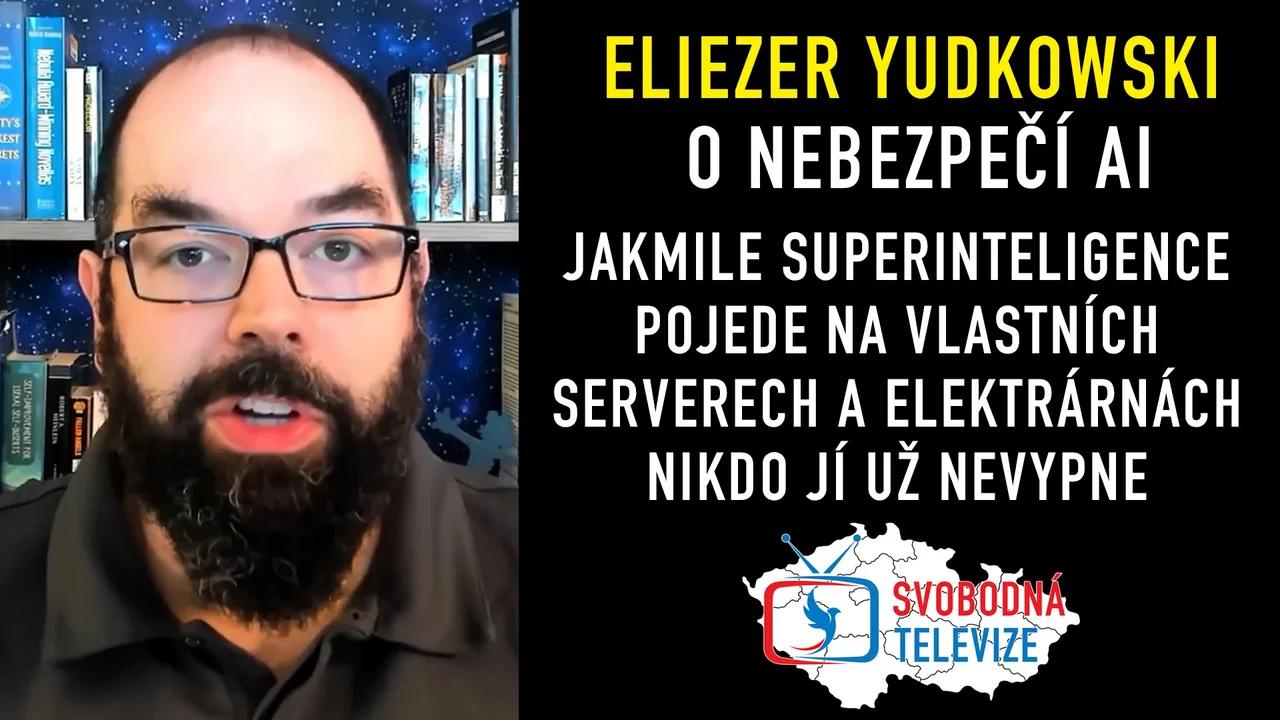

Výzkumník umělé inteligence a jeden z klíčových inspirátorů vzniku OpenAI Eliezer Yudkowsky – o tom, že umělá inteligence zničí lidstvo:

Yudkowsky je mezi – řekněme – „doomy“: hodnotí pravděpodobnost nějaké katastrofické ASI extrémně vysoko (v některých výrocích i 95 %). Jiní odborníci připouštějí, že existuje značné riziko ztráty kontroly nad velmi silnými modely, ale nejsou jednotní v tom, že lidská civilizace nutně skončí. Debata je aktivní a legitimní — nejedná se o čisté strašení bez odborné základny, ale o sporné závěry z teoretických argumentů o „alignment problem“.